ObjectScale

ObjectScale.Next: un anno di prestazioni inarrestabili per i dati AI

L’AI continua a innalzare gli standard per lo storage. Le GPU non possono rimanere inattive in attesa di I/O. Funzionalità di streaming, embedding e artefatti intermedi non possono essere limitati da colli di bottiglia di piccoli oggetti. L’inferenza degli LLM non può essere scalabile se la cache KV è bloccata nella memoria GPU anziché alimentare gli acceleratori alla velocità di linea.

Dal rilascio della versione 4.0 di appena un anno fa, ObjectScale ha accumulato innovazioni in termini di prestazioni per oggetti di piccole e grandi dimensioni, RDMA, percorsi dati compatibili con GPU e offload della cache KV, abbinandoli alla più recente tecnologia server Dell PowerEdge All‑Flash, preservando al contempo l’architettura exascale, l’efficienza e la semplicità su cui le aziende fanno affidamento.

Questo focus sulle prestazioni è uno dei motivi principali per cui ObjectScale è stato nominato prodotto dell’anno 2025 secondo CRN per lo storage di livello enterprise, un premio assegnato dalla redazione che evidenzia l’impatto di ObjectScale sulle attuali sfide per i dati aziendali più impegnative.

Un’unica piattaforma, miglioramenti delle prestazioni che si accumulano nel tempo

Nei deployment di ObjectScale software‑defined su server Dell PowerEdge qualificati, i test interni hanno mostrato un throughput di lettura per nodo fino a 40 GB/s1, un dato fino a 8 volte più veloce1 rispetto alle piattaforme di oggetti All‑Flash della generazione precedente. Ciò offre ai team di AI un engine compatto e a larghezza di banda elevata per set di addestramento di grandi dimensioni, checkpoint e carichi di lavoro di dimensioni miste.

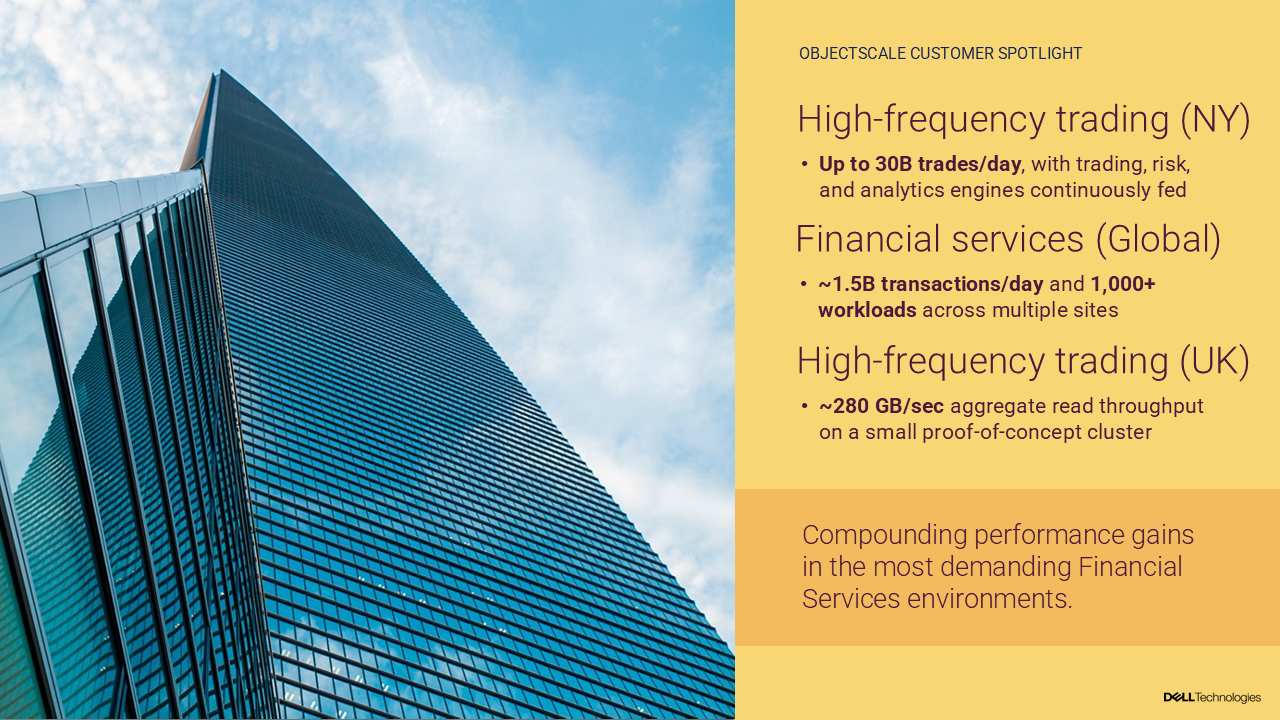

Questi vantaggi si estendono ben oltre il laboratorio. Oggi, ObjectScale sta dimostrando le sue capacità in alcuni dei contesti più impegnativi:

- Trading ad alta frequenza su larga scala: una grande società di trading ad alta frequenza (HFT) con sede a New York elabora oltre 30 miliardi di transazioni al giorno, affidandosi a ObjectScale per garantire un apporto costante di dati agli engine di trading, rischio e analisi.

- Servizi finanziari globali: una società finanziaria di livello globale utilizza un ambiente ObjectScale basato su HDD multi‑sito per elaborare 1,5 miliardi di transazioni giornaliere, servendo al contempo oltre 1.000 carichi di lavoro di AI, analisi e backup tramite self‑service automatizzato.

- Trading ad alta frequenza con sede nel Regno Unito: una società di trading ad alta frequenza con sede nel Regno Unito ha sostenuto circa 280 GB/s di throughput di lettura aggregato in un cluster proof‑of‑concept di ObjectScale di piccole dimensioni.

Oggetti di piccole dimensioni, prestazioni elevate: archiviazione a blocchi e ottimizzazioni chiave‑valore

Le moderne pipeline di AI sono dominate da oggetti di piccole dimensioni: registri, metriche, funzionalità, segmenti di tabelle, blocchi vettoriali e artefatti di addestramento intermedi. Se il Tier degli oggetti non è in grado di gestire oggetti di piccole dimensioni in modo efficiente, tutto ciò che si trova a valle rallenta. ObjectScale dà la possibilità ai clienti di creare in tutta sicurezza pipeline di AI con oggetti di piccole dimensioni.

Lo fa tramite un engine di archiviazione a blocchi che raggruppa molti oggetti di piccole dimensioni in blocchi da 128 MB prima di applicare la codifica di erasure e distribuire i dati tra i nodi. Per i tipici file da 10 KB, in un singolo blocco possono risiedere oltre 10.000 oggetti, riducendo l’overhead dei metadati e il lavoro di ricostruzione.

Che cosa significa per i clienti:

- Throughput più elevato di oggetti di piccole dimensioni e latenza inferiore, in particolare su cluster XF960 All‑Flash e X560 basati su HDD di ObjectScale ottimizzati per letture di oggetti di piccole dimensioni.

- Ricostruzioni più rapide e prestazioni più prevedibili: la codifica di erasure basata su blocchi riduce da miliardi a milioni le frammentazioni da ricostruire dopo guasti di dischi o nodi, in modo che le unità NVMe di grandi dimensioni possano essere ricostruite in poche ore anziché settimane.

- Meno CPU sprecata durante la scansione in background: ObjectScale esegue il checksum degli oggetti inline ed effettua quindi la verifica a livello di stripe, liberando i cicli della CPU per le letture e le scritture attive.

In ObjectScale 4.2, un archivio chiave‑valore riprogettato porta questo aspetto al livello successivo, offrendo un’efficienza della memoria 4 volte superiore2 e un utilizzo del disco inferiore del 30‑60%2 per i metadati. Le ricerche rimangono veloci e prevedibili anche con l’aumento del numero di cluster e oggetti.

Alimentazione di GPU e LLM: S3 su RDMA e cache KV

Man mano che i team di AI aumentano la scalabilità dell’addestramento e dell’inferenza, il collo di bottiglia diventano sempre più spesso lo spostamento dei dati e la gestione della memoria di contesto, anziché la capacità di elaborazione raw. Le versioni di 4a generazione di ObjectScale si concentrano su entrambi gli aspetti.

S3 su RDMA: accesso agli oggetti con bassa latenza e larghezza di banda elevata

S3 su RDMA (introdotto in ObjectScale 4.2 e migliorato nella versione 4.3) sostituisce il TCP tradizionale con RDMA per l’accesso a S3, offrendo enormi vantaggi per i client nei test interni:

- Throughput più elevato del 230%

- Latenza inferiore dell’80% circa

- E riduzione dell’utilizzo della CPU fino al 98%…

… rispetto a S3 su TCP.3

Con il rilascio della versione 4.3, S3 su RDMA per ObjectScale è disponibile in tutto il portafoglio All‑Flash (ObjectScale software‑defined su R7725xd, XF960 e EXF900), rendendo possibile l’accesso ai dati degli oggetti con latenza ultra‑bassa e throughput elevato.

Integrando l’SDK S3 su RDMA di Dell con il supporto GPU e uno stack di rete RoCEv2, ObjectScale supera i tradizionali colli di bottiglia di TCP e CPU, creando un percorso quasi diretto tra GPU e SSD NVMe nello storage a oggetti per pipeline di AI complesse.

Cache KV: trasformare ObjectScale in un acceleratore di inferenza

Con il passaggio alla produzione degli LLM, la cache KV (Key‑Value Cache) diventa essenziale. Anziché rielaborare gli stati di attenzione per ogni token, i framework di inferenza riutilizzano la cache KV, ma questa cache supera rapidamente le capacità della memoria GPU. L’offload della cache KV in ObjectScale rende possibile offrire esperienze di AI più rapide e reattive.

La soluzione scalabile di offload della cache KV di Dell, con tecnologia ObjectScale e PowerScale, sposta la cache KV dalla memoria GPU allo storage condiviso a prestazioni elevate utilizzando vLLM, LMCache, la libreria NIXL di NVIDIA e l’integrazione di S3 accelerata da RDMA di Dell.

I benchmark mostrano:

- Time to First Token (TTFT) fino a 19 volte più veloce4 rispetto a una configurazione vLLM standard di rielaborazione della cache KV sulla GPU.

- Throughput dei token fino a 5,3 volte superiore5 e throughput multi‑turno quasi 3 volte superiore5 nei test di Dell InfoHub, anche con cache KV multi‑gigabyte archiviate su ObjectScale e PowerScale.

- TTFT della cache KV di circa 0,86 secondi6 su ObjectScale nel confronto diretto con un engine concorrente, con prestazioni superiori rispetto a VAST nei test pubblicati.

Tabelle S3: analisi ottimizzata per l’AI senza il rallentamento dell’ETL

In ObjectScale 4.3 (anteprima tecnica), le tabelle S3 portano l’analisi nativa delle tabelle basata su Apache Iceberg direttamente nei bucket ObjectScale. Le tabelle risiedono su S3 e possono essere sottoposte a query da engine come Spark, Flink, Trino e Starburst senza copiare i dati in database o warehouse separati, riducendo il carico dell’ETL e le dipendenze esterne.

I test interni hanno mostrato:

- Acquisizione fino a 2 volte più veloce7

- Query fino a 4,5 volte più veloci7

rispetto ai modelli tradizionali incentrati sui warehouse, mentre il recupero automatizzato dello storage e l’IAM unificati contribuiscono a mantenere le prestazioni elevate e le operazioni più semplici nel tempo. ObjectScale passa dall’essere una semplice zona di destinazione a una superficie di analisi attiva a prestazioni elevate per i team di AI e BI.

Prestazioni senza rinunciare a scalabilità, efficienza o semplicità

Le prestazioni sono utili solo in termini di scalabilità, efficienza e semplicità. Le versioni di quarta generazione di ObjectScale migliorano anche queste dimensioni:

- Un archivio chiave‑valore modernizzato supporta una crescita del VDC globale fino al 122%8 rispetto a versioni precedenti con molta meno memoria e spazio su disco per i metadati.

- La compressione a livello di bucket e più algoritmi (Snappy, LZ4, ZSTD, Deflate) aiutano i team a ottimizzare la velocità o il rapporto in base al carico di lavoro e l’analisi della compressione trasforma i risparmi in un segnale FinOps anziché in un’impostazione alla cieca.

- Le nuove opzioni di codifica di erasure 24+2 e 24+4 di ObjectScale riducono l’amplificazione di scrittura fino al 75%9, riducendo l’usura dei supporti e l’overhead in background, in modo che più I/O servano le applicazioni; i clienti ottengono un’acquisizione di oggetti di grandi dimensioni più veloce del 25%10, oltre al raddoppio delle prestazioni di scrittura di oggetti di medie dimensioni11 su piattaforme HDD ad alta capacità, come EX500.

- Il bilanciamento del carico integrato, il recupero dello spazio di replica geografica migliorato e gli strumenti nativi per il cloud (COSI Kubernetes, Terraform) mantengono gestibili gli ambienti ObjectScale su larga scala man mano che crescono.

Il risultato è una piattaforma in cui le prestazioni migliorate e la semplicità operativa si integrano perfettamente, senza costringere i team a dover scegliere tra le due opzioni.

Perché è importante una roadmap ObjectScale incentrata sulle prestazioni

Con l’aumento della complessità dei modelli di AI e delle pipeline di dati, la roadmap di ObjectScale rimane incentrata sulle prestazioni, che si tratti di spingere ulteriormente sul throughput di oggetti di piccole e grandi dimensioni, estendere S3 su percorsi dati compatibili con RDMA e GPU o approfondire l’integrazione con cache KV, memoria di contesto e ricerca ottimizzata per l’AI.

Per le organizzazioni che stanno creando la loro nuova generazione di AI e analisi, ciò si traduce in una semplice promessa: non sarà l’archivio oggetti a frenarle.

Fonti

1Dati basati su un’analisi condotta da Dell in cui ObjectScale 4.2 su PowerEdge R7725xd è stato confrontato con ECS 3.8 su ECS EXF900 per le prestazioni di lettura degli oggetti, settembre 2025. I risultati effettivi sono soggetti a variazioni.

2Dati basati su analisi Dell in cui l’archivio chiave‑valore di ObjectScale 4.2 è stato confrontato con quello utilizzato in ObjectScale 4.1, agosto 2025. I risultati effettivi sono soggetti a variazioni.

3Dati basati su test interni di Dell ObjectScale S3 su RDMA, dicembre 2025. I risultati effettivi sono soggetti a variazioni.

4Dati basati su test interni eseguiti da Dell Technologies utilizzando il modello LLaMA‑3.3‑70B Instruct con parallelismo tensoriale = 4. I test hanno misurato le prestazioni TTFT (Time to First Token) con un cache hit della cache KV del 100%, confrontando lo stack vLLM + LMCache + NVIDIA NIXL di Dell sullo storage PowerScale e ObjectScale con una configurazione vLLM standard di riferimento. I risultati effettivi sono soggetti a variazioni. novembre 2025.

5Dati basati su test interni eseguiti da Dell Technologies utilizzando il modello LLaMA‑3.3‑70B Instruct con parallelismo tensoriale = 4. I test hanno misurato il throughput TPS (token al secondo) utilizzando la suite di inferenza multi‑turno LMbenchmark, confrontando lo stack vLLM + LMCache + NVIDIA NIXL di Dell sullo storage PowerScale e ObjectScale con una configurazione di riferimento che usa vLLM standard con memorizzazione nella cache solo della memoria GPU. I risultati effettivi sono soggetti a variazioni. novembre 2025.

6Dati basati su test interni eseguiti da Dell Technologies utilizzando il modello LLaMA‑3.3‑70B Instruct con parallelismo tensoriale = 4. I test hanno misurato le prestazioni TTFT (Time to First Token) con un tasso di cache hit della cache KV del 100%. I risultati effettivi sono soggetti a variazioni. novembre 2025.

7Dati basati su test su tabella interni di Dell ObjectScale S3, settembre 2025. I risultati effettivi sono soggetti a variazioni.

8Dati basati su analisi Dell in cui l’archivio dei chiave‑valore di ObjectScale 4.2 è stato confrontato con quello utilizzato in ObjectScale 4.1, agosto 2025. I risultati effettivi sono soggetti a variazioni.

9Dati basati su test interni Dell condotti su schemi EC 24+4 e 24+2 rispetto a 12+4 sul codice AFA e ObjectScale 4.3, dicembre 2025. I risultati effettivi sono soggetti a variazioni.

10Dati basati su test interni condotti da Dell sul codice 4.3 su XF960 con il confronto dei 3 schemi di codifica di erasure, dicembre 2025. I risultati effettivi sono soggetti a variazioni.

11Dati basati su test interni condotti da Dell sulle funzioni abilitate su ObjectScale 4.3 su HDD rispetto alle funzionalità disabilitate, dicembre 2025. I risultati effettivi sono soggetti a variazioni.