ObjectScale

ObjektScale.Next: Et år med suveræn ydelse for AI-data

AI hæver hele tiden barren for storage. GPU’er kan ikke være inaktive og vente på I/O. Streamingfunktioner, integrationer og mellemliggende artefakter kan ikke begrænses af flaskehalse bestående af små objekter. LLM-inferens kan ikke skaleres, hvis KV-cache er fanget i GPU-hukommelsen i stedet for at fodre acceleratorer i linjehastighed.

Siden 4.0-udgivelsen for blot et år siden har ObjectScale stablet ydeevneinnovationer på tværs af små og store objekter, RDMA, GPU‑bevidste datastier og KV‑cache‑aflastning, der parrer dem med den nyeste all‑flash Dell PowerEdge‑serverteknologi, samtidig med at den Exascale‑arkitektur, ‑effektivitet og ‑enkelhed, som virksomheder er afhængige af, bevares.

Dette fokus på ydeevne er en af de vigtigste grunde til, at ObjectScale blev kåret til CRN’s Årets produkter 2025 for storage i virksomhedsklassen—en redaktionelt udvalgt pris, der fremhæver ObjectScales indvirkning på nutidens hårdeste dataudfordringer for virksomheder.

En platform, der forøger ydeevnefordelene

I softwaredefinerede ObjectScale‑udrulninger på kvalificerede Dell PowerEdge‑servere har interne test vist, at læseoverførselshastigheden pr. node er op til 40 GB/sek1 —op til 8 gange hurtigere1 end tidligere generationers all‑flash‑objektplatforme. Det giver AI‑teams et kompakt system med høj båndbredde til store træningssæt, kontrolpunkter og workloads af blandet størrelse.

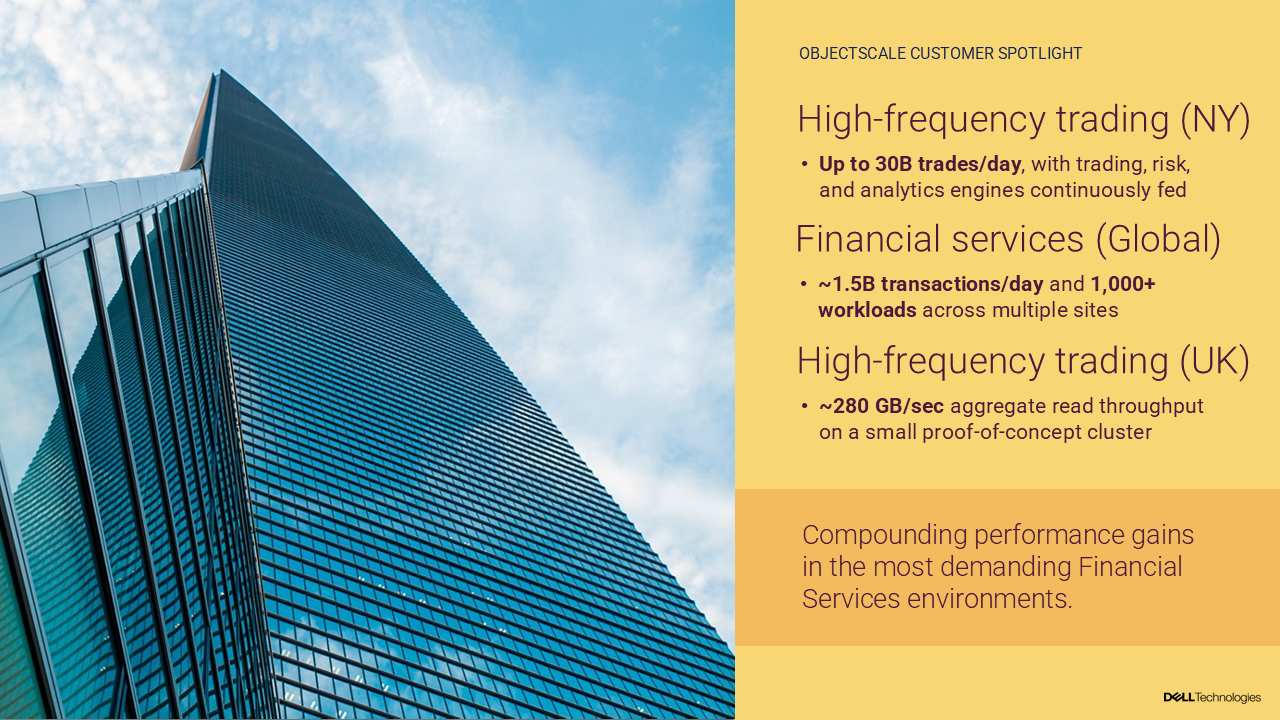

Disse gevinster rækker langt ud over laboratoriet. I dag viser ObjectScale sit værd i nogle af de mest krævende miljøer:

- Højfrekvent handel i stor skala: En stor New York‑baseret handelsvirksomhed, der beskæftiger sig med højfrekvent handel (HFT), behandler op mod 30 milliarder transaktioner om dagen, og anvender ObjectScale til at holde handel, risici og analysesystemer løbende forsynet med data.

- Globale finansielle services: Et globalt finansinstitut bruger et HDD‑baseret ObjectScale‑miljø fordelt på flere lokationer til at behandle 1,5 milliarder daglige transaktioner og betjener samtidig mere end 1.000 AI‑, analyse‑ og sikkerhedskopieringsworkloads via automatiseret selvbetjening.

- Højfrekvent handel baseret i Storbritannien: Et højfrekvenshandelsfirma beliggende i Storbritannien har opretholdt ca. 280 GB/sek. samlet læsehastighed på en lille ObjectScale proof‑of‑concept‑klynge.

Små objekter, stor ydeevne: Bloklager og Key‑Value‑optimeringer

Moderne AI‑pipelines er domineret af små objekter: Logfiler, målinger, funktioner, tabelsegmenter, vektorblokke og mellemliggende træningsartefakter. Hvis objektniveauet ikke kan håndtere små objekter effektivt, bliver alt efterfølgende langsommere. ObjectScale giver kunderne mulighed for trygt at opbygge AI‑pipelines bestående af mange små objekter.

Det gør den via et bloklagersystem, der pakker mange små objekter i 128 MB blokke, før der anvendes sletning af kode og distribueres data på tværs af noder. For typiske 10 KB filer kan der være mere end 10.000 objekter i en enkelt blok, hvilket reducerer metadataberegningsomkostninger og genopbygger arbejde.

Hvad betyder det for kunderne:

- Højere overførselshastighed af små objekter og mindre ventetid – især på all‑flash ObjectScale XF960 og HDD‑baserede X560‑klynger, der er finindstillet til læsning af små objekter.

- Hurtigere genopbygninger og mere forudsigelig ydeevne – blokbaseret sletning af kode reducerer shards for at genskabe efter disk‑ eller nodefejl fra milliarder til millioner, så store NVMe‑drev kan genopbygges på få timer i stedet for uger.

- Mindre CPU spildt på baggrundsscanning – ObjectScale beregner kontrolsummen af objekter direkte og verificeres derefter på stripe‑niveau, hvilket frigør CPU‑cyklusser til aktive læsninger og skrivninger.

I ObjectScale 4.2 tager et redesignet Key‑Value Store dette videre og leverer ca. 4 gange bedre hukommelseseffektivitet2 og 30–60 % mindre diskforbrug2 til metadata. Opslag forbliver hurtige og forudsigelige, selv i takt med at antallet af klynger og objekter vokser.

Fodring af GPU’er og LLM’er: S3 over RDMA og KV‑cache

Efterhånden som AI‑teams skalerer træning og inferens, bliver flaskehalsen i stigende grad dataflytning og konteksthukommelse, ikke rå databehandling. ObjectScales 4.‑generations udgivelser fokuserer på begge dele.

S3 over RDMA: Objektadgang med høj båndbredde og mindre ventetid

S3 over RDMA (introduceret i ObjectScale 4.2 og forbedret i 4.3) erstatter traditionel TCP med RDMA for S3‑adgang, hvilket giver betydelige klientfordele i interne test:

- Op til 230 % højere overførselshastighed

- Ca. 80 % mindre ventetid

- Og op til 98 % mindre CPU‑forbrug…

…sammenlignet med S3 over TCP.3

Med udgivelse 4.3 er S3 over RDMA til ObjectScale tilgængelig på tværs af all‑flash‑porteføljen—softwaredefineret ObjectScale på R7725xd, XF960 og EXF900—hvilket muliggør ultralav ventetid og høj overførselshastighed til objektdata.

Ved at integrere Dells S3‑over‑RDMA SDK med GPU‑understøttelse og en RoCEv2‑netværksstak omgår ObjectScale traditionelle TCP‑ og CPU‑flaskehalse og skaber en næsten direkte sti mellem GPU’er og NVMe SSD i objektstorage til krævende AI‑pipelines.

KV‑cache: Gør ObjectScale til en inferensaccelerator

Når LLM’er kommer i produktion, bliver Key‑Value (KV) Cache afgørende. I stedet for at genberegne opmærksomhedstilstande for hvert token genbruger inferensstrukturer KV‑cache—men denne cache vokser meget hurtigere end GPU‑hukommelsen. Ved at læsse KV‑cache over i ObjectScale kan der leveres hurtigere og mere responsive AI‑oplevelser.

Dells skalerbare KV‑cacheaflastningsløsning, drevet af ObjectScale og PowerScale, skifter KV‑cache fra GPU‑hukommelse til højtydende, delt storage ved hjælp af vLLM, LMCache, NVIDIA’s NIXL‑bibliotek og Dells RDMA‑accelererede S3‑integration.

Benchmarks viser:

- Op til 19 gange hurtigere tid til First Token (TTFT)4 vs. en vLLM‑standardkonfiguration til gendatabehandling af KV‑cache på GPU’en.

- Op til 5,3 gange højere token‑overførselshastighed5 og næsten 3 gange højere multi‑turn‑overførselshastighed5 i Dells InfoHub‑test, selv med flere gigabyte KV‑caches gemt på ObjectScale og PowerScale.

- KV‑cache TTFT på ca. 0,86 sekunder6 på ObjectScale i direkte sammenligninger med et konkurrerende system, klarer sig bedre i publicerede tests.

S3‑tabeller: AI‑optimeret analyse uden ETL‑besvær

I ObjectScale 4.3 (Tech Preview) bringer S3‑tabeller Apache Iceberg‑baserede, tabelbaserede analyser direkte til ObjectScale‑beholdere. Tabeller findes på S3 og kan forespørges af systemer som Spark, Flink, Trino og Starburst uden at kopiere data til separate databaser eller lagre, hvilket reducerer ETL‑omkostninger og eliminerer eksterne afhængigheder.

Intern test har vist:

- Op til 2 gange hurtigere indtagelse7

- Op til 4,5 gange hurtigere forespørgsler7

sammenlignet med traditionelle lagercentrerede mønstre, mens automatiseret genbrug af storage og samlet IAM hjælper med at holde ydeevnen høj og driften enklere over tid. ObjectScale skifter fra blot at være et destinationsområde til at fungere som en aktiv, højtydende analyseoverflade for AI‑ og BI‑teams.

Ydeevne uden at gå på kompromis med skalering, effektivitet eller enkelhed

Ydeevne er kun nyttig, hvis den leveres med skalering, effektivitet og enkelhed. ObjectScales 4.‑generations udgivelser fremmer desuden disse dimensioner:

- Et moderniseret Key‑Value Store understøtter global VDC‑vækst på op til 122 %8 i forhold til tidligere versioner og bruger langt mindre hukommelse og diskplads til metadata.

- Komprimering på beholderniveau og flere algoritmer (Snappy, LZ4, ZSTD, Deflate) gør det muligt for teams at finjustere hastigheden eller forholdet efter workload med komprimeringsanalyser, der forvandler besparelser til et FinOps‑signal i stedet for en blindindstilling.

- ObjectScales nye indstillinger for 24+2‑ og 24+4‑sletning af kode reducerer skriveforstærkningen med op til 75 %9, hvilket reducerer medieslitage og baggrundsoverhead, så mere I/O understøtter programmer. Kunderne oplever op til 25 % hurtigere indtagelse af store objekter10 samt op til 2 gange bedre skriveydeevne for mellemstore objekter11 på HDD‑platforme med høj kapacitet som EX500.

- En integreret belastningsafbalancering, forbedret geo‑replikeringsplads og cloudbaserede værktøjer (Kubernetes COSI, Terraform) holder ObjectScale‑miljøer i stor skala håndterbare, efterhånden som de vokser.

Resultatet er en platform, hvor forbedringer af ydeevnen og driftsmæssig enkelhed går hånd i hånd i stedet for at tvinge teams til at skulle vælge.

Derfor er det vigtigt med en ObjectScale‑køreplan for fokus på ydeevne

Efterhånden som AI‑modeller og datapipelines bliver mere komplekse, forbliver ObjectScales køreplan fokus på ydeevne—uanset om det er at skubbe overførselshastigheder af små‑ og store‑objekter endnu længere, udvide S3 over RDMA og GPU‑bevidste datastier eller uddybe integrationen med KV‑cache, konteksthukommelse og AI‑optimeret søgning.

For organisationer, der opbygger deres næste generation af AI og analyser, kan det koges ned til et simpelt løfte: Dit objektlager er ikke det, der holder dig tilbage.

Kilder

1Baseret på Dells analyse, der sammenligner objektlæsningsydeevnen for ObjectScale 4.2 på PowerEdge R7725xd til ECS 3.8 på ECS EXF900, september 2025. De faktiske resultater kan variere.

2Baseret på Dell’s analyse, der sammenligner Key Value Store i ObjectScale 4.2 med det, der bruges i ObjectScale 4.1, august 2025. De faktiske resultater kan variere.

3Baseret på Dells interne test af ObjectScale S3 over RDMA, december 2025. De faktiske resultater kan variere.

4Baseret på intern Dell Technologies‑test ved hjælp af LLaMA‑3.3‑70B Instruct‑modellen med Tensor Parallelism=4. Tester den målte tid til første token‑ydeevne (TTFT) med en hitrate på 100 % KV‑cache, der sammenligner Dells vLLM + LMCache + NVIDIA NIXL‑stak på PowerScale‑ og ObjectScale‑storage med en grundlæggende vLLM‑standardkonfiguration. De faktiske resultater kan variere. November 2025.

5Baseret på intern Dell Technologies‑test ved hjælp af LLaMA‑3.3‑70B Instruct‑modellen med Tensor Parallelism=4. Tester målt TPS‑overførselshastighed (tokens pr. sekund) ved hjælp af LMbenchmark Multi‑Turn‑inferenspakke, der sammenligner Dells vLLM + LMCache + NVIDIA NIXL‑stak på PowerScale‑ og ObjectScale‑storage med en basiskonfiguration ved hjælp af standard‑vLLM kun med GPU‑caching. De faktiske resultater kan variere. November 2025.

6Baseret på intern Dell Technologies‑test ved hjælp af LLaMA‑3.3‑70B Instruct‑modellen med Tensor Parallelism=4. Testene målte tid til første token‑ydeevne (TTFT) med en KV‑cache‑hitrate på 100 %. De faktiske resultater kan variere. November 2025.

7Baseret på Dells interne test af ObjectScale S3‑tabeller, september 2025. De faktiske resultater kan variere.

8Baseret på Dell’s analyse, der sammenligner Key Value Store i ObjectScale 4.2 med det, der bruges i ObjectScale 4.1, august 2025. De faktiske resultater kan variere.

9Baseret på Dells interne test af 24+4 og 24+2 EC‑ordninger sammenlignet med 12+4 på AFA‑ og ObjectScale 4.3‑kode, december 2025. De faktiske resultater kan variere.

10Baseret på Dells interne test af 4.3‑kode på XF960 med sammenligning af 3 planer for sletning af kode, december 2025. De faktiske resultater kan variere.

11Baseret på Dell’s interne test af funktioner aktiveret på ObjectScale 4.3 på HDD sammenlignet med funktion deaktiveret, december 2025. De faktiske resultater kan variere.